Когда Тим Бернерс-Ли придумал Web, сеть задумывалась как открытая, децентрализованная система, где каждый может не только читать, но и писать, где знания связаны между собой, а доступ к ним не требует разрешений и не зависит от чьей-либо воли. За три десятилетия этот замысел изменился до неузнаваемости.

В развитом мире Web оказался подчинен логике платформ: внимание стало товаром, алгоритмы — посредниками между человеком и реальностью, а данные — сырьем для глобальной индустрии.

В авторитарных системах трансформация пошла еще дальше: интернет превратился в управляемую среду, где доступ к информации дозируется, а сама Сеть все чаще становится инструментом контроля и пропаганды.

Но за этим разговором о свободе и архитектуре выросла другая проблема, менее заметная, но более фундаментальная. Она не про устройство Сети, а про то, как мы воспринимаем реальность через нее.

Главным вопросом стало: «Можем ли мы понять, чему из этого вообще можно верить?» Это не просто смена формулировки. Это тектонический сдвиг: мы перешли от кризиса дефицита к кризису валидности.

Новый кризис интернета — это кризис проверяемости реальности.

От избытка информации — к избытку правдоподобия

Интернет долго воспринимался как пространство избыточной информации. Ключевым вызовом был шум: его слишком много, нужно уметь фильтровать, отсеивать лишнее, находить зерна в плевелах.

Сегодня изменилась не только плотность шума, изменилась сама его природа. Фейк больше не выглядит как фейк. Он может быть стилистически безупречным, визуально точным, эмоционально убедительным. Его производство стало быстрым, дешевым и практически неограниченным — от текста до видео и «свидетельств очевидцев». Основная проблема в том, что ложь научилась носить костюм истины зачастую лучше, чем сама истина.

В новой среде побеждает не тот, кто говорит правду, а тот, чья версия реальности «запостится» быстрее, будет ярче, злее и лучше заточена под алгоритмы.

Что лучше «заходит»?

Здесь вступает в игру второй актер драмы — платформы. Их алгоритмы не оптимизированы на достоверность. Им все равно, правда перед ними или вымысел. Они оптимизированы на вовлечение, они усиливают то, что лучше «заходит». А лучше всего «заходят» простые объяснения сложных вещей, конфликты, крайние позиции, визуально сильный контент — вне зависимости от его точности.

Правда в этой системе не запрещена, она просто менее конкурентоспособна.

Но самый глубокий сдвиг происходит не на уровне технологий, а на уровне человеческого восприятия.

Когда человек постоянно сталкивается с противоречащими друг другу версиями событий, когда одно и то же видео одни называют неопровержимым доказательством, а другие — искусной подделкой, когда любой факт можно оспорить, сославшись на «фейк» или «заказ», — происходит нечто страшное.

Размывается базовое доверие. Не к конкретному источнику, а к самой возможности установить истину. Возникает состояние, которое философы назвали бы эпистемологической апатией: «Все равно ничего не поймешь, у каждого своя правда».

Это принципиально новая ситуация.

Раньше пропаганда стремилась убедить, сегодня она все чаще стремится разрушить саму идею проверяемой реальности. А если правды нет, то за что бороться?

Почему правда проигрывает

Если попытаться описать происходящее одной фразой, она будет звучать так: ложь стала дешевой, быстрой и технологичной, а правда осталась по-прежнему дорогой и медленной.

Это новое уравнение переписало баланс сил в публичном пространстве.

Еще недавно создание убедительной лжи требовало ресурсов, сопоставимых с запуском небольшой фабрики. Нужны были редакции, типографии, студии звукозаписи, съемочные группы, спецэффекты, время. Ложь была либо продуктом государственной машины (дорогостоящая пропаганда), либо результатом серьезной медийной операции с бюджетом и штатом.

Сегодня эта фабрика умещается в рюкзаке: ноутбук, доступ в Сеть и умение работать с нейросетями. Генеративные модели научились штамповать то, что раньше считалось неотъемлемым признаком подлинности. Связный текст в любом стиле? Пожалуйста. Фотография «с места событий», которой никогда не было? Легко. Голос человека, произносящего слова, которые он в жизни не говорил? Синтезируется за минуты. Видео, где политик «признается» в чудовищных вещах? Уже реальность, от которой у зрителя волосы встают дыбом.

Мы вступили в эпоху, где доказательство можно сгенерировать так же легко, как и само утверждение. И это ломает привычную логику доверия. Раньше у нас была простая эвристика: если есть фото или видео, значит, это было. Теперь их происхождение всегда можно оспорить.

Весной 2023 года по соцсетям разошлось изображение «взрыва у Пентагона»: правдоподобное, стилистически безупречное, с «новостной» подачей. Его успели подхватить агрегаторы, а финансовые рынки на короткое время отреагировали снижением. Позже выяснилось: изображение было сгенерировано.

Мы потеряли якорь реальности.

Правда всегда опаздывает

Вторая проблема — скорость.

Согласно исследованию MIT, ложная информация распространяется в Сети намного быстрее правдивой, в отдельных случаях до шести раз.

Особенно хорошо работает профессионально «упакованная» ложь: чем сильнее она цепляет внимание, тем быстрее алгоритмы разгоняют ее дальше, превращая распространение в самовозбуждающийся, вирусный процесс.

Проверка же устроена иначе, она требует времени: найти первоисточник, сопоставить данные, получить комментарии, проверить контекст, убедиться в подлинности.

В результате возникает чудовищная асимметрия: ложь появляется мгновенно, а правда всегда догоняет и приходит тогда, когда мнение уже сформировано.

В 2022 году в разгар российско-украинского конфликта появилось видео, на котором Владимир Зеленский якобы призывает украинских военных сложить оружие. Ролик был быстро разоблачен, но сам факт его появления показал: даже грубая подделка способна мгновенно войти в информационный поток и начать работать — до того, как включается проверка.

Известно, что опровержения читают в десять раз реже, чем сенсации, и их редко публикуют на первых полосах.

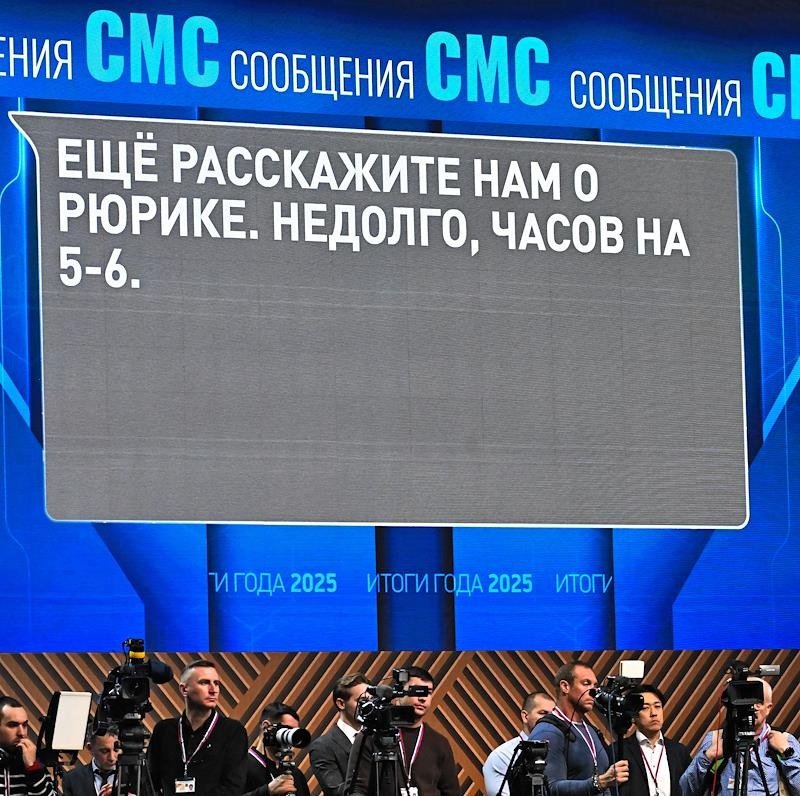

Фото: Игорь Иванко / Коммерсантъ

Фрагменты вместо целого

Третья критическая проблема — исчезновение контекста. Современный контент живет в виде Reels, Shorts и TikTok, то есть фрагментов: это вырванные из интервью куски, короткие ролики, обрезанные цитаты.

Из этих осколков можно собрать практически что угодно:

- поменять смысл, не меняя слов;

- создать конфликт там, где его не было;

- превратить частное в общее.

Это как читать книгу, в которой кто-то произвольно переставил страницы, вырезал главы и поменял местами заголовки. Формально текст «родной», ничего нового не придумано, но смысл поменялся.

Показательный пример — сцена на церемонии «Оскар» 2022 года, где Уилл Смит ударил Криса Рока. В соцсетях разошелся короткий фрагмент — сам момент удара, и для миллионов зрителей это выглядело как внезапная, ничем не спровоцированная агрессия. Позже появились более полные версии — с шуткой, реакцией и последующими словами. В зависимости от длины ролика менялась и оценка происходящего — от «хамства и недопустимого насилия» до «эмоциональной, но законной реакции на грубое оскорбление». Ничего не было подделано, но реальность оказалась разной, в зависимости от того, какой кусок увидел зритель.

Манипуляция становится персональной

Раньше пропаганда работала «по площадям»: один месседж на всех: газета выходила единым тиражом, листовки печатались одним текстом, радио и ТВ вещали одну и ту же сводку для всех.

Теперь она работает по каждому отдельно, добро пожаловать в эпоху микротаргетинга! Алгоритмы знают о вас почти все: что вас интересует, веселит или раздражает, чего вы боитесь, в какие теории заговора вы уже склонны верить, какие образы вызывают у вас доверие.

И под этот индивидуальный портрет подстраивается подача.

Одному и тому же событию для разных людей даются разные объяснения, обрамленные в разную эмоциональную упаковку. Для консерватора — одна версия, для либерала — другая, для скептика — третья, «разоблачающая» обе предыдущие.

В результате два человека могут жить в соседних домах, но видеть две абсолютно несовместимые картины мира. И каждая из этих картин будет для них выглядеть логичной, подтвержденной фактами и разделяемой «нормальными людьми». Потому что алгоритмы создали для каждого свой персональный информационный кокон.

Впервые масштаб этого механизма стал очевиден в 2018 году, когда выяснилось, что компания Cambridge Analytica использовала данные десятков миллионов пользователей Facebook* для политического микротаргетинга — подбирая разные сообщения под психологический профиль каждого человека.

Вот как это было. В 2018 году расследования журналистов показали, что компания Cambridge Analytica получила доступ к данным десятков миллионов пользователей Facebook.

На основе лайков, подписок и поведения в сети строились психологические профили: уровень тревожности, склонность к риску, политические предпочтения. Дальше начиналась настройка сообщений. Пользователям показывали разную политическую рекламу — не просто по возрасту или региону, а по личным психологическим характеристикам. Одни видели ролики, усиливающие страх и чувство угрозы, другие — апелляции к традициям, третьи — «рациональные» аргументы и разоблачения. Разные группы получали разные версии одной и той же реальности и не знали, что существует другая.

Эффект «правдоподобного шума»

Но, возможно, главный эффект достигается не отдельными фейками и единичными вбросами, а их количеством. Когда ложных, искаженных, полуправдивых сообщений становится слишком много, человек перестает проверять — не потому что ему лень или все равно, а потому что проверять физически невозможно.

Так рождается новая форма психологической защиты — информационное безразличие. Человек перестает верить во что-либо вообще, он пожимает плечами и говорит: «Все врут», «Ничего не разобрать», «У каждого своя правда».

И это состояние является целевым для манипуляторов — люди перестают верить в саму возможность истины, и в этом тумане можно протащить почти что угодно.

Фото: Олеся Курпяева / Коммерсантъ

Критическое мышление как инфраструктура

История технологий — это всегда история их двойного применения и неизбежной гонки вооружений. Энрико Ферми, запуская цепную реакцию, мечтал об источнике неисчерпаемой энергии для Человечества, но побочным эффектом мы получили Хиросиму. Создатели интернета тоже видели перед собой «паутину» знаний, а не сеть для тотальной слежки и манипулирования сознанием.

Искусственный интеллект — кульминация этой драмы. Он способен усиливать науку, образование и медицину, и в то же время индустриализировать ложь, подделку и фабрикацию реальности.

Масштаб происходящего трудно переоценить. Крупнейшие технологические компании уже инвестируют в инфраструктуру искусственного интеллекта сотни миллиардов долларов в год — в дата-центры, чипы, энергию. Только четыре игрока — Open AI, Amazon, Google и Meta** — в ближайшие годы выходят на совокупные капитальные расходы более полутриллиона долларов ежегодно. Для масштаба: военный бюджет Китая оценивают в $245–300 млрд, России — около $140–150 млрд ежегодно.

То есть инвестиции технологических компаний в вычислительную инфраструктуру для AI уже превышают расходы на оборону крупнейших военных держав мира, с той разницей, что речь идет не о распределенных многомилионных армиях и военных базах, а о концентрации ресурсов в одной точке: вычислительной мощности.

История не знала прецедентов, чтобы частные компании сосредоточивали в своих руках такую мощь. Это уже не просто рынок и не очередной инвестиционный цикл, который схлынет через пару лет. Это борьба за право обладать инфраструктурой, на которой будет собираться и обрабатываться сама человеческая мысль.

Искусственный интеллект перестает быть продуктом, который можно купить в коробке или получить из облака. Он превращается в среду, такую же всепроникающую, как электричество или интернет.

Только если электричество питает лампочки, а интернет соединяет знания, то новая среда будет питать смыслы и соединять их в картины мира. Кто будет контролировать эту среду и кто пропишет ее базовые протоколы?

На этом фоне призывы к личной бдительности начинают звучать почти издевательски. Требовать от человека, чтобы он «просто был внимательнее» и «проверял источники», значит закрывать глаза на подлинный масштаб происходящего.

Человек оказался лицом к лицу с системой, у которой почти бесконечный ресурс и абсолютное терпение. С системой, способной производить правдоподобный контент с конвейерной скоростью, которая к тому же знает о нем то, чего он сам о себе, возможно, не осознает: страхи, подавленные желания, готовые триггеры. И под этот психологический профиль она выстраивает бесконечную ленту — идеально подогнанный поток, в котором правда и ложь перемешаны так, чтобы не вызвать отторжения. А если что-то все же вызывает реакцию — гнев, восторг, ужас, — алгоритм немедленно корректирует сигнал и закрепляет эффект.

Это концептуально неравный бой, партия, в которой у соперника право менять правила по ходу игры и полный доступ к вашим картам.

Представьте, что нам объявили бы: отныне каждый сам отвечает за свою защиту от эпидемии. Мойте руки, носите маски, не подходите к больным, а больницы, вакцины и санитарный контроль — это излишество. Звучит как абсурд, потому что мы знаем: индивидуальная гигиена работает только внутри общей системы здравоохранения.

В информационной среде происходит то же самое. Личная внимательность необходима, но сама по себе она беспомощна без общественных институтов проверки, законов, независимой фактчекинговой инфраструктуры, без новых образовательных стандартов, которые учат не просто воспринимать, а воспринимать критически.

Критическое мышление должно стать частью общественной гигиены.

А это означает неизбежный вывод: чистая информационная среда, как и чистая окружающая среда или медицина, стоит денег. Общество уже давно платит налогами за безопасность и здоровье. Теперь ему придется признать, что за устойчивость к дезинформации тоже нужно платить.

Потому что цена отказа значительно выше: разрушенное доверие, радикализация, управляемость массовым сознанием.

Поддержите

нашу работу!

Нажимая кнопку «Стать соучастником»,

я принимаю условия и подтверждаю свое гражданство РФ

Если у вас есть вопросы, пишите [email protected] или звоните:

+7 (929) 612-03-68

Четыре инструмента

Если посмотреть на проблему в масштабе, у общества есть четыре базовых инструмента.

1. Образование: грамотность как иммунитет

Речь не о факультативе «Безопасный интернет» для галочки. Речь о новой базовой грамотности, такой же обязательной, как когда-то умение писать и считать.

Человек XXI века должен уметь:

- отличать факт от его интерпретации (новости — от колонки);

- отделять первоисточник от пересказа (даже если пересказ громче);

- видеть разницу между оригиналом и синтетической подделкой;

- опознавать манипуляцию под упаковкой заботы или гнева.

Отсутствие навыка работать с информацией становится такой же уязвимостью, как неграмотность в прошлом.

2. Прозрачность платформ: «формирователи реальности» не должны быть черными ящиками

Сегодня алгоритмы формируют картину мира у миллиардов людей, но при этом сами остаются «черным ящиком»: их логика — коммерческая тайна, не подлежащая общественному аудиту.

В долгосрочной перспективе это колоссальные риски. И речь не о том, чтобы чиновники назначали, что кому показывать. Речь о другом:

- объяснимость: почему алгоритм настроен именно так?

- отчетность: какие системные риски (поляризация, радикализация) он создает?

- доступ: исследователи и аудиторы должны получить доступ и право изучать влияние платформ, не упираясь в гриф «ноу-хау».

Это не контроль контента, а гигиена среды, в которой он циркулирует.

3. Массовый фактчекинг: скорая помощь вместо вскрытия

Классическая проверка фактов, которой занимаются редакции, — дело штучное, медленное, а потому и дорогое. Пока фактчекер проверит одну новость, фабрика фейков выбросит тысячу новых.

Значит, проверка должна сменить масштаб, стать встроенной функцией цифровой среды.

Как мы писали выше, любую технологию можно обратить и во вред, и во благо. Да, искусственный интеллект сегодня штампует убедительную ложь с невиданной скоростью. Но та же самая скорость, та же когнитивная мощь, тот же мгновенный доступ к миллионам источников могут работать и на стороне правды. Просто до сих пор правда пользовалась этим ресурсом реже — у нее не было такого же бюджета и заказа.

Представьте: автоматическая первичная верификация прямо в браузере; сигнал «это видео вызывает сомнения» в мессенджере; мгновенная экспертиза полученного документа. Все это — не фантастика, а вопрос направления ресурсов.

Фото: Пелагия Тихонова / Коммерсантъ

Фактчекинг должен догнать ложь по скорости и масштабу. А для этого ему придется стать автоматизированным, массовым и доступным каждому — как связь или скорая помощь. И у нас уже есть все инструменты, чтобы это сделать.

4. Происхождение контента: паспорт для файла

Последний, самый глубокий слой — возвращение к реальности через следы.

В аналоговом мире у вещи было происхождение: можно было спросить, где сделано, какой состав, контроль качества, как сюда попало. В цифровом мире информация чаще всего анонимна — без истории, без паспорта, без ответственных источников.

Современные технологии позволяют вернуть эту прозрачность. Маркеры происхождения: кто создал файл, редактировался ли он, использовался ли искусственный интеллект. Это не гарантия правды, но возможность проверки пути. Если файл не может ответить на эти вопросы, то доверять ему стоит с огромной осторожностью.

Это не утопия. Это минимальные требования к реальности, в которой мы согласны жить.

Северная Европа: как строят общественный иммунитет

Один из самых последовательных ответов сегодня дают страны Северной Европы, которые рассматривают дезинформацию не как «проблему интернета», а как фактор общественной устойчивости, и отвечают на него целой системой мер.

В североевропейской модели медиаграмотность начинается не с кампаний против фейков, а со школы. Финляндия — один из самых показательных примеров. Здесь медиаграмотность закреплена на уровне государственной политики и координируется отдельным публичным институтом — Национальным аудиовизуальным институтом (KAVI).

Национальная политика медиаграмотности, принятая министерством образования и культуры, исходит из простой идеи: эти навыки должны быть доступны каждому и встроены в систему образования, а не оставаться инициативой отдельных учителей.

В Норвегии пошли еще дальше — там критическое мышление прямо закреплено в учебных стандартах. От школьника требуется не просто запомнить и пересказать параграф.

Он обязан уметь анализировать источник, понимать, чья это точка зрения и почему она именно такая, сопоставлять разные позиции и — страшно сказать! — участвовать в общественной дискуссии. То есть школа готовит не потребителя информации, а ее исследователя.

Швеция, всегда внимательная к демократическим процедурам, в последние годы добавила к медиаграмотности еще и AI-грамотность. Правительство официально поручает профильным агентствам развивать эти навыки в масштабах всей страны — уже в контексте защиты выборов и общественного диалога.

Северяне строят не систему запретов, а вырабатывают коллективный иммунитет: умение работать с информацией рассматривается не как дополнительный навык, а как новая базовая грамотность. И пока остальной мир мечется между цензурой и вседозволенностью, они просто учат своих детей задавать правильный вопрос: «Откуда я это знаю и почему я должен в это верить?»

Второй уровень — не содержание, а среда, в которой оно распространяется. Страны Северной Европы действуют здесь в связке с общеевропейской регуляторикой, прежде всего с Digital Services Act. Этот подход не требует от государства определять, что является правдой, но вводит обязательства для платформ:

- раскрывать принципы работы алгоритмов;

- оценивать системные риски;

- давать исследователям доступ к данным;

- и нести ответственность за архитектуру распространения.

На национальном уровне эта рамка дополняется институциями.

В Дании, например, создан отдельный координатор по реализации DSA, встроенный в систему цифрового управления. В Швеции противодействие дезинформации рассматривается как часть гражданской обороны. Специальное агентство — Psychological Defence Agency — занимается выявлением и сопротивлением внешним информационным воздействиям, включая работу с органами власти и обществом в периоды повышенного риска, например, во время выборов.

Здесь важен принцип: регулируется не мнение, а инфраструктура его распространения.

Фактчекинг: от ремесла к системе

Третий уровень — проверка информации.

Локальные институты по-прежнему критически важны. В Финляндии давно и успешно работает Faktabaari («Фактобус»). Название выбрано с умыслом: это не кафедра истины, а скорее передвижная мастерская, которая приезжает туда, где нужна помощь. Faktabaari уже много лет совмещает классическую проверку фактов с образовательной работой, а в 2024–2025 годах выпустил отдельный AI Guide for Teachers — руководство для учителей по искусственному интеллекту, и целый пакет материалов для школ.

В Норвегии Faktisk.no вырос в независимую площадку, созданную в сотрудничестве шести крупнейших конкурирующих медиа, а его образовательное подразделение Tenk («Думай») с 2019 года работает именно на стыке фактчекинга и школы.

В Швеции фактчекинг все заметнее институционализируется вокруг журналистских и исследовательских центров вроде Fojo/SweFactCheck, а в 2026 году там запущен проект Valkollen 2026 для поддержки редакций верификацией, анализом дезинформации и выявлением AI-манипуляций перед выборами.

Но сама структура задачи подталкивает к следующему шагу. Проверять локальный политический фейк можно в Хельсинки, Стокгольме или Осло.

А вот инструменты первичной верификации — поиск дубликатов, сопоставление с уже существующими проверками, распознавание синтетики, общие архивы фактчеков, сигналы для платформ — логичнее строить на уровне всей европейской и платформенной инфраструктуры.

Именно к этому движется ЕС, создавая общеевропейскую инфраструктуру проверки информации: European Digital Media Observatory (EDMO) — объединение исследователей, фактчекеров и университетов, которое собирает и анализирует случаи дезинформации по всей Европе, формирует общие базы проверок и изучает, как работают платформы.

Параллельно действует Code of Practice on Disinformation — добровольный, но уже фактически обязательный для крупных платформ свод правил, который требует от них прозрачности, борьбы с фейками и сотрудничества с фактчекерами. Сейчас он встроен в более жесткую законодательную рамку — Digital Services Act (DSA), европейский закон, который обязывает крупные платформы учитывать риски дезинформации и отчитываться о том, как они с ними работают.

В 2025 году Еврокомиссия пошла еще дальше и запустила отдельную программу поддержки European Network of Fact-Checkers, сети независимых организаций, работающих по единым стандартам. Это важный сигнал: для масштабной проверки информации уже недостаточно отдельных редакций и национальных инициатив. Нужны общие инструменты, общие базы и координация на уровне всей цифровой среды.

Фото: Дмитрий Азаров / Коммерсантъ

Происхождение контента и экономика правды

Четвертый уровень самый сложный.

Речь идет уже не только о проверке информации, но о понимании ее происхождения и о том, кто оплачивает ее создание.

В североевропейской повестке усиливается внимание к прозрачности контента и доверию к цифровой среде, включая развитие AI-грамотности и обсуждение механизмов маркировки и происхождения информации.

Логика здесь понятна: если мы можем видеть, откуда пришел контент и как он был создан, нам проще ему доверять. Но маркировка может показать происхождение информации, но не создать ее, и тем более не гарантировать ее достоверность. И здесь возникает более глубокий вопрос: если правда становится инфраструктурой, кто оплачивает ее производство?

Производство правды не может быть дешевым. Журналистам нужно платить зарплату, расследования требуют времени и командировок; фактчекерам необходим доступ к базам и экспертам, а AI-инструментам — оплата разработчиков, вычислений и данных. Школьные программы по медиаграмотности требуют учителей, методичек, часов в расписании. Все это стоит денег — и немалых.

В то же время производство лжи, как мы уже видели, стремительно дешевеет и упрощается. В результате возникает экономическая асимметрия, которая начинает определять, какая версия реальности масштабируется быстрее.

Один из первых системных ответов дала Австралия. В 2021 году там был принят News Media Bargaining Code — закон, который обязал крупные цифровые платформы вести переговоры с новостными медиа и платить за использование их контента. По сути, государство впервые напрямую вмешалось в экономику цифровой среды, зафиксировав простой принцип: если платформы зарабатывают на распространении информации, они должны делиться доходом с теми, кто ее производит.

В 2025 году Австралия предложила следующий шаг — модель News Bargaining Incentive, которая должна стимулировать платформы не уклоняться от соглашений, например, просто убирая новости из ленты, а, наоборот, системно участвовать в финансировании качественного контента. Это попытка закрепить принцип: достоверная информация — это общественный ресурс, и ее производство требует устойчивого финансирования.

Северная Европа пока сильнее в построении «иммунитета» общества через образование, институты и доверие, Австралия — в попытке перераспределить цифровую ренту. И вместе эти подходы очерчивают возможную модель будущего.

Вместо вывода: чтобы человек остался человеком

Мир меняется с такой скоростью, что вчерашние антиутопии уже не кажутся развлекательной литературой. Еще недавно такие произведения, как «Матрица» или книги Пелевина о подмене реальности, о манипуляции сознанием и о мире симулякров, казались гиперболой, интеллектуальной провокацией, предупреждением на вырост.

Сегодня эта метафора стала средой обитания. Человек все чаще живет не в общей реальности, а в персонально подобранном пузыре. Видит не мир, а его алгоритмическую проекцию сквозь призму собственных страхов, желаний и предубеждений. Именно поэтому нам так страшно: мы начинаем чувствовать, что теряем не просто ориентиры, а саму почву под ногами.

Отсюда и соблазн самых радикальных ответов: Запретить. Отключить. Остановить. Отменить.

Луддизм XXI века уже здесь — от призывов заморозить развитие самых мощных AI-систем до почти религиозного требования просто выключить интернет, как будто вместе с Сетью исчезнут и те силы, которые через нее действуют.

Такие призывы сегодня звучат не только на периферии: в 2025 году более 700 подписантов открытого письма требовали запретить разработку сверхинтеллекта, а недавно один из провластных идеологов призывал вообще отключить интернет в России на весну и лето, чтобы люди могли «жить реальной человеческой жизнью».

Но история слишком хорошо знает и другое: общества, которые пытаются спастись отказом от прогресса, не сохраняют себя — они просто отстают. Они не отменяют будущее, а отдают его другим.

Выбор иной: либо новые технологии будут пересобирать человека стихийно — в интересах рынка, власти, пропаганды и машинной оптимизации, либо человек сам пересоберет институты, правила и культуру так, чтобы технологии оставались человеческим инструментом, а не становились новой средой подчинения.

В этом смысле сегодня особенно точно звучит фраза из «Леопарда» Джузеппе Томази ди Лампедузы: «Se vogliamo che tutto rimanga com'è, bisogna che tutto cambi» — «Если мы хотим, чтобы все осталось как есть, нужно, чтобы все изменилось». Парадокс нашего времени в том, что именно радикальные изменения теперь нужны не для разрушения человеческого мира, а для его сохранения.

Чтобы человек остался человеком — не функцией алгоритма, не объектом манипуляции, не потребителем синтетических иллюзий, а существом разумным, свободным, образованным, способным к состраданию, сомнению и независимому суждению, — нам придется менять очень многое.

Пересобирать школу. Пересобирать медиа. Пересобирать отношения между государством, платформами и обществом. Пересобирать саму архитектуру доверия.

И возможно, признать трудную вещь: в XXI веке борьба идет уже не только за свободу слова, доступ к информации и правду. Она идет за право человека не потерять связь с реальностью, и вместе с ней не потерять самого себя.

* Принадлежит компании Meta, признанной экстремистской и запрещенной в РФ.

** Признана экстремистской и запрещена в РФ.

Поддержите

нашу работу!

Нажимая кнопку «Стать соучастником»,

я принимаю условия и подтверждаю свое гражданство РФ

Если у вас есть вопросы, пишите [email protected] или звоните:

+7 (929) 612-03-68